最近,威斯康辛麦迪逊大学、微软和香港科技大学的研究人员提出了一种SEEM模型,该模型能够对包含视觉、文本和语音提示的任何输入进行一次性分割。这种通用性使得SEEM能够应对各种不同类型的数据和任务,例如语义分割、实例分割、全景分割、动作捕捉等等。此外,SEEM还具有语义感知能力,可以在不需要提前学习的情况下进行任意组合的分割。

研究方法:

SEEM使用一种名为SEEM的编码器-解码器模型,它能够对包含多种输入的模型进行学习。SEEM模型采用了常见的卷积神经网络架构,并在其上加入了注意力机制和自注意力机制,以学习在各种输入数据中进行分割的最佳策略。

同时,SEEM模型也支持多种视觉和语音提示,并通过提供对不同提示类型的交互式建议来增强其多样性。

实验结果:

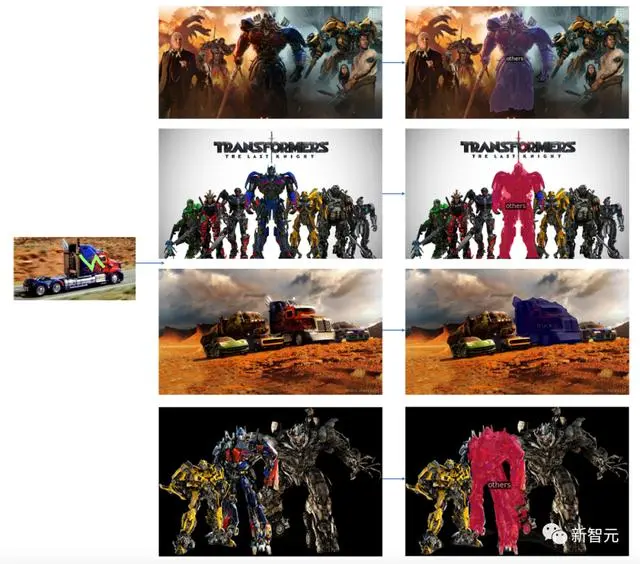

SEEM模型在多项分割任务中展现出了有效性和泛化能力。在变形金刚的合影中,SEEM能够将「擎天柱」与其他物体区分开来。

在视频分割任务中,SEEM能够将输入视频自动分割为图像和视频序列。

此外,SEEM还能够在不需要提前学习的情况下,对分割任务进行任意组合的优化。SEEM的出现为计算机视觉领域的分割研究提供了一种全新的方法和思路。

应用前景:

SEEM的出现将对计算机视觉、自然语言处理和多模态信息处理等领域产生深远的影响。其主要应用包括:图像分割、视频分割、实例分割、全景分割、动作捕捉等。这项工作为计算机视觉研究提供了一个全新的方向和起点,未来SEEM模型还将会在更多领域得到应用和发展。

论文链接:

https://arxiv.org/pdf/2304.06718.pdf

项目链接:

https://github.com/UX-Decoder/Segment-Everything-Everywhere-All-At-Once

© 版权声明

文章版权归作者所有,未经允许请勿转载。