5月4日消息:NVIDIA 推出了一系列尖端的人工智能研究,包括生成式人工智能和神经图形学,这些研究将于今年在 SIGGRAPH 上展示。

这些研究包括生成人工智能模型,将文本转换为个性化图像,反向渲染工具,使用 AI 模拟复杂 3D 元素的神经物理模型以及神经渲染模型。

这些研究将帮助开发人员和企业快速生成合成数据,以填充机器人和自动驾驶汽车培训的虚拟世界,并且使艺术、建筑、平面设计、游戏开发和电影领域的创作者能够更快地为故事板、预览甚至制作高质量的视觉效果。

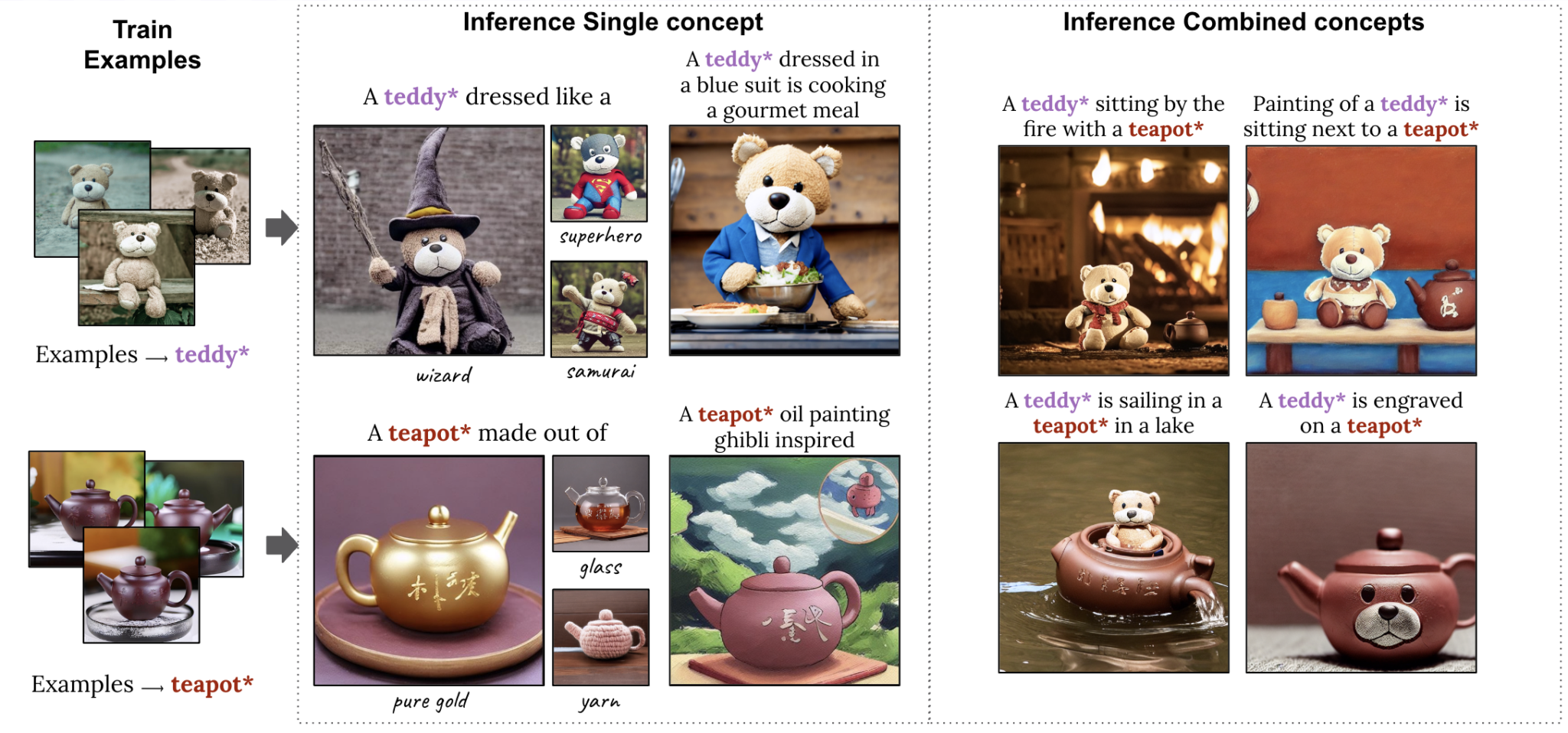

具有个性化触感的 AI:定制的文本到图像模型

将文本转换为图像的生成式 AI 模型是为电影、视频游戏和 3D 虚拟世界创建概念艺术或故事板的强大工具。特拉维夫大学和 NVIDIA 的研究人员在 SIGGRAPH 上发表了两篇论文,使用户能够提供模型快速学习的图像示例。这些论文描述了一种需要单个示例图像来自定义其输出的技术,并且介绍了一种名为 Perfusion 的高度紧凑的模型,该模型采用一些概念图像,允许用户将多个个性化元素组合成一个 AI 生成的视觉效果。这些技术可以帮助艺术家更快地为特定主题创作视觉效果。

3D服务:逆向渲染和角色创建的进步

NVIDIA Research正在开发人工智能技术,帮助创作者将2D图像和视频转换为3D表示。他们发明了一项技术,可以自动将2D图像和视频转换为逼真的3D模型,使创作者可以将其导入图形应用程序进行进一步编辑。此外,他们还与加州大学圣地亚哥分校和斯坦福大学合作,开发了两个项目。第三篇论文介绍了一种基于单个3D肖像生成和渲染逼真的2D头肩模型的技术。第四个项目是一个人工智能系统,可以从真实网球比赛的2D视频记录中学习一系列网球技能,并将这种动作应用于3D角色。这些技术可以帮助创作者更快地创建3D角色和场景,并使其动作更逼真,而无需使用昂贵的动作捕捉数据。

没有一根头发错位:神经物理学可实现逼真的模拟

在3D角色制作中,叠加逼真的细节是一个复杂且计算成本高昂的挑战,例如头发。头发对个体的运动和周围环境做出动态反应,每个人头上平均有100万根头发。传统上,创作者使用物理公式来计算头发运动,但在大预算电影中的虚拟角色比实时视频游戏化身更详细的头发头。第五篇论文介绍了一种使用神经物理学的方法,可以高分辨率实时模拟数万根头发。神经物理学是一种人工智能技术,可以教授神经网络预测物体在现实世界中的移动方式。

专门针对现代GPU进行了优化。与基于CPU的求解器相比,该方法提供了显著的性能提升,将模拟时间从几天缩短到仅几个小时,并提高了实时头发模拟的质量。这种技术实现了准确和交互式的基于物理的头发梳理。

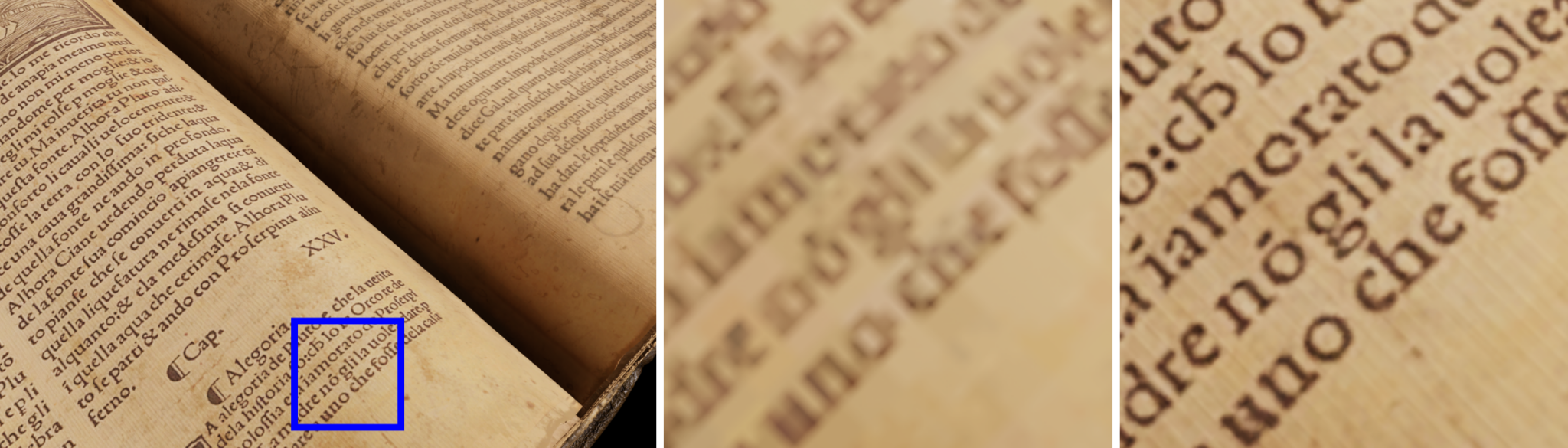

神经渲染为实时图形带来电影级细节

在动画3D对象和角色被放置在环境中后,实时渲染将模拟虚拟场景中反射的光的物理特性。NVIDIA的最新研究表明,AI模型可以为视频游戏和数字孪生实时提供电影质量、逼真的视觉效果,包括纹理、材质和体积。在第六篇SIGGRAPH论文中,NVIDIA介绍了神经纹理压缩技术,可以在不占用额外GPU内存的情况下提供高达16倍的纹理细节。这项技术可以显著提高3D场景的真实感。

神经纹理压缩(右)提供的纹理细节比以前的纹理格式多 16 倍,而无需使用额外的 GPU 内存。

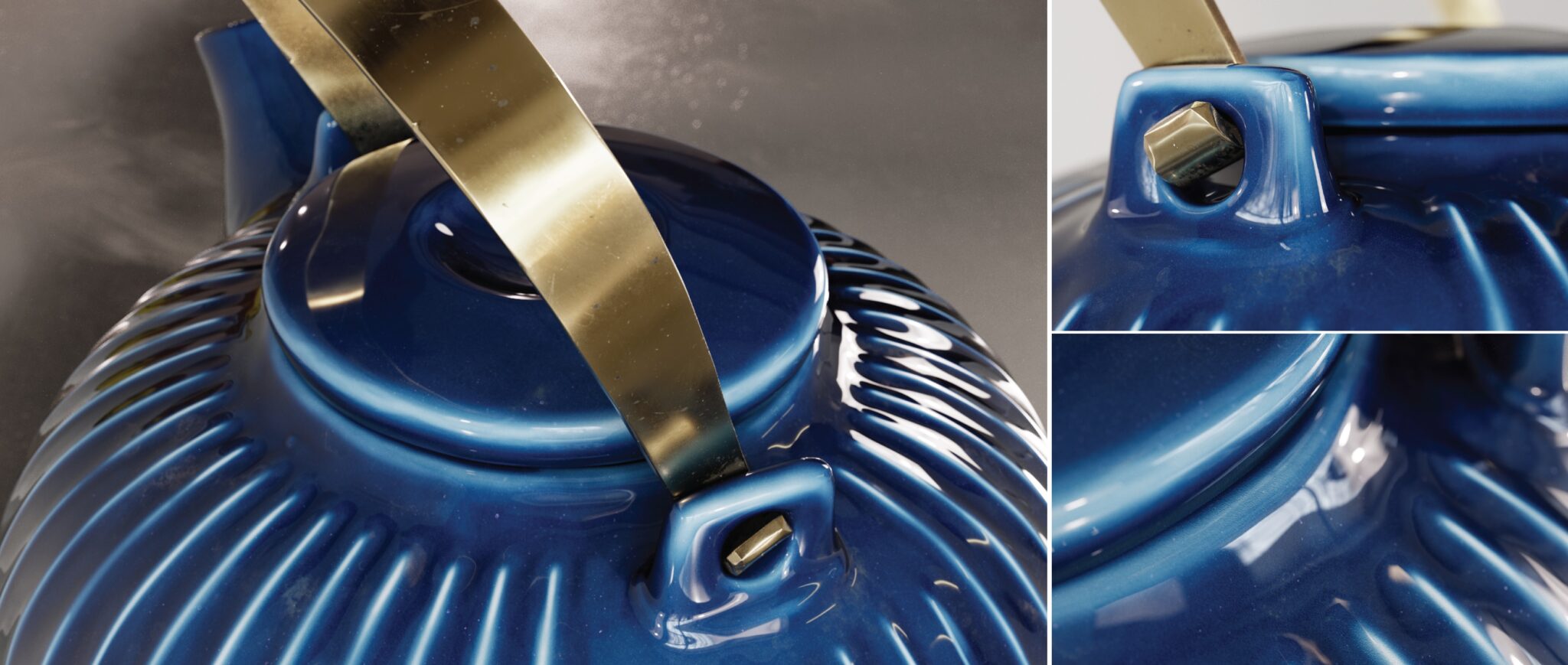

神经材料模型学习光如何从多层、逼真的参考材料反射。

NVIDIA提供了一种名为NeuralVDB的数据压缩技术,可以将表示体积数据(如烟、火、云和水)所需的内存减少100倍,并支持人工智能。此外,NVIDIA还发布了有关神经材料研究的更多详细信息,该论文描述了一个人工智能系统,可以学习光线如何从逼真的多层材料反射,将这些资产的复杂性降低到实时运行的小型神经网络,使着色速度提高10倍。这个神经渲染的茶壶展示了真实感水平,准确地代表了陶瓷、不完美的清漆釉、指纹、污迹甚至灰尘。